- 在英伟达第二季度263亿美元的数据中心收入中,Inference占了40%。

- 随着人工智能的成熟,推理计算的需求将会增加。

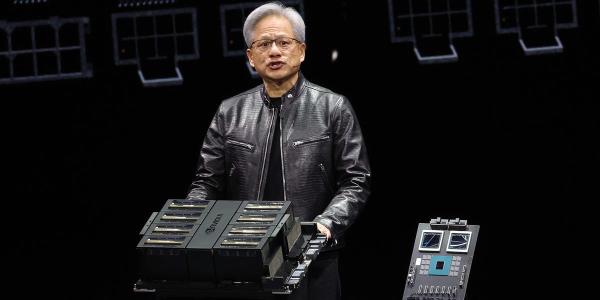

- Groq和Cerebras等公司正在推出推理芯片,与英伟达竞争。

在人工智能硬件圈里,几乎每个人都在谈论推理。

英伟达首席财务官科莱特•克雷斯(Colette Kress)在周三的财报电话会议上说,在英伟达第二季度263亿美元的数据中心营收中,约有40%来自推断业务。AWS首席执行官马特·加曼最近在No prior播客上表示,目前人工智能计算服务器上一半的工作可能是推理。而且这一份额很可能会增长,吸引渴望削弱英伟达王冠的竞争对手。

本文仅对Business Insider订阅者开放。成为业内人士,现在就开始阅读。有账户吗?.因此,许多希望从英伟达那里夺取一些市场份额的公司都是从推理开始的。

由谷歌校友组成的创始团队创立了Groq,专注于推理硬件,并在8月份以28亿美元的估值筹集了6.4亿美元。

2023年12月,Positron AI推出了一款推理芯片,据称可以执行与英伟达H100相同的计算,但价格便宜五倍。亚马逊正在开发训练和推理芯片——分别被恰当地命名为Trainium和Inferentia。

“我认为多样性越多,我们的处境就越好,”加曼在同一个播客上说。

有关的故事

据首席执行官安德鲁·费尔德曼介绍,以超大人工智能训练芯片而闻名的加州公司Cerebras上周宣布,它已经开发出了一款同样大的推理芯片,这是市场上最快的。

并非所有的推理芯片都是一样的

为人工智能工作负载设计的芯片必须针对训练或推理进行优化。

训练是开发人工智能工具的第一阶段——当你将标记和注释的数据输入模型时,它就可以学习产生准确和有用的结果。推理是在模型被训练后产生这些输出的行为。

训练芯片倾向于优化纯粹的计算能力。推理芯片需要较少的计算量,实际上一些推理可以在传统的cpu上完成。这项任务的芯片制造商更关心延迟,因为令人上瘾的人工智能工具和令人讨厌的人工智能工具之间的区别往往归结为速度。这正是大脑公司首席执行官安德鲁·费尔德曼所指望的。

据该公司称,该芯片的内存带宽是英伟达H100的7000倍。这就是费尔德曼所说的“极速”。

该公司已经开始了首次公开募股(IPO)的进程,还推出了包括免费套餐在内的多层服务。

“推理是一个内存带宽问题,”费尔德曼告诉《商业内幕》。

为了赚钱在AI中,扩展推理工作负载

选择优化用于训练或推理的芯片设计不仅仅是一个技术决策,也是一个市场决策。大多数制造人工智能工具的公司在某些时候都需要这两种工具,但他们的大部分需求可能会在一个领域或另一个领域,这取决于公司在其构建周期中的位置。

大量的训练工作量可以被认为是人工智能的研发阶段。当一家公司转向以推理为主时,这意味着它制造的任何产品都是为终端客户服务的——至少在理论上是这样。

随着越来越多的人工智能项目和初创公司的成熟,预计推理将代表绝大多数计算任务。事实上,根据AWS的Garman的说法,这是实现数千亿美元人工智能基础设施投资尚未实现的回报所需要的。

Garman告诉No prior:“推理工作负载必须占据主导地位,否则所有这些对大型模型的投资都不会真正得到回报。”

然而,对于芯片设计师来说,训练和推理的简单二元关系可能不会永远持续下去。

数据中心业主Databank的首席执行官Raul Martynek说:“我们数据中心的一些集群,客户同时使用它们。

英伟达最近收购了Run。ai可能会支持Martynek的预测,即推理和训练之间的墙可能很快就会倒塌。

今年4月,英伟达同意收购以色列公司Run:ai,但据Politico报道,这笔交易尚未完成,目前正在接受美国司法部的审查。Run:ai的技术使gpu的运行效率更高,允许在更少的芯片上完成更多的工作。

“我认为,对大多数企业来说,它们会合并。你将有一个训练和推理的集群,”Martynek说。

英伟达拒绝对这篇报道置评。

本文来自作者[冰之]投稿,不代表5664玩立场,如若转载,请注明出处:https://5664wan.cn/zheh/202412-6332.html

评论列表(4条)

我是5664玩的签约作者“冰之”!

希望本篇文章《在人工智能芯片业务的这一关键领域,英伟达实际上可能会亏损》能对你有所帮助!

本站[5664玩]内容主要涵盖:国足,欧洲杯,世界杯,篮球,欧冠,亚冠,英超,足球,综合体育

本文概览: 在英伟达第二季度263亿美元的数据中心收入中,Inference占了40%。随着人工智能的成熟,推理计算的需求将会增加。Groq和Cerebras等公司正在推出推理芯片,与...